Расизм и ИИ: «предрассудки прошлого ведут к предрассудкам в будущем»

30 июля 2024

«Последние разработки в сфере искусственного интеллекта и их активное применение по-прежнему ставят серьезные вопросы в области прав человека, в том числе в отношении расовой дискриминации», – заявила Специальный докладчик по вопросу о современных формах расизма, расовой дискриминации, ксенофобии и связанной с ними нетерпимости Ашвини К.П.

В ходе интерактивного диалога на 56-й сессии Совета по правам человека в Женеве, Швейцария, посвященного публикации ее нового доклада, Ашвини К.П. отметила широкое распространение неверного представления о технологии как о нейтральной и объективной.

В своем докладе она исследует, как такое представление позволяет искусственному интеллекту поддерживать расовую дискриминацию.

«Генеративный искусственный интеллект меняет мир и обладает потенциалом для осуществления значимых изменений в будущем, – сказала Ашвини К.П. – Я глубоко обеспокоена стремительным расширением использования искусственного интеллекта в различных областях. Это не связано с тем, что искусственный интеллект не имеет потенциальных преимуществ. На самом деле он открывает возможности для инноваций и инклюзивности».

Ярким примером того, как расовые предрассудки распространяются с помощью развития технологий, является прогнозирование полицейской деятельности. Инструменты такого прогнозирования позволяют оценить, кто может совершить преступление в будущем и где оно может произойти, на основании информации о местоположении и личных данных.

«Прогнозирование в полицейской деятельности может усугубить исторически сложившуюся ситуацию с усилением полицейских мер в районах по расовому и этническому признаку, – заявила Ашвини К.П. – Поскольку сотрудники правоохранительных органов всегда обращали особое внимание на такие районы, представители этих сообществ намного чаще фигурируют в полицейских сводках. Это, в свою очередь, влияет на то, как алгоритмы предсказывают, где произойдут преступления в будущем, и, соответственно, где полиция усилит свое присутствие».

Она выяснила, что для прогнозирования того, где и когда с большей вероятностью будут совершены преступления, такие алгоритмы анализируют связь между местами, событиями и историческими данными о преступлениях, а полицейские силы планируют патрулирование в соответствии с этими прогнозами.

“

Когда сотрудники полиции в районах с усиленными мерами охраны порядка регистрируют новые правонарушения, возникает петля обратной связи, в результате чего алгоритм генерирует более предвзятые прогнозы в отношении этих районов. Иными словами, предрассудки прошлого ведут к предубеждениям в будущем.

“

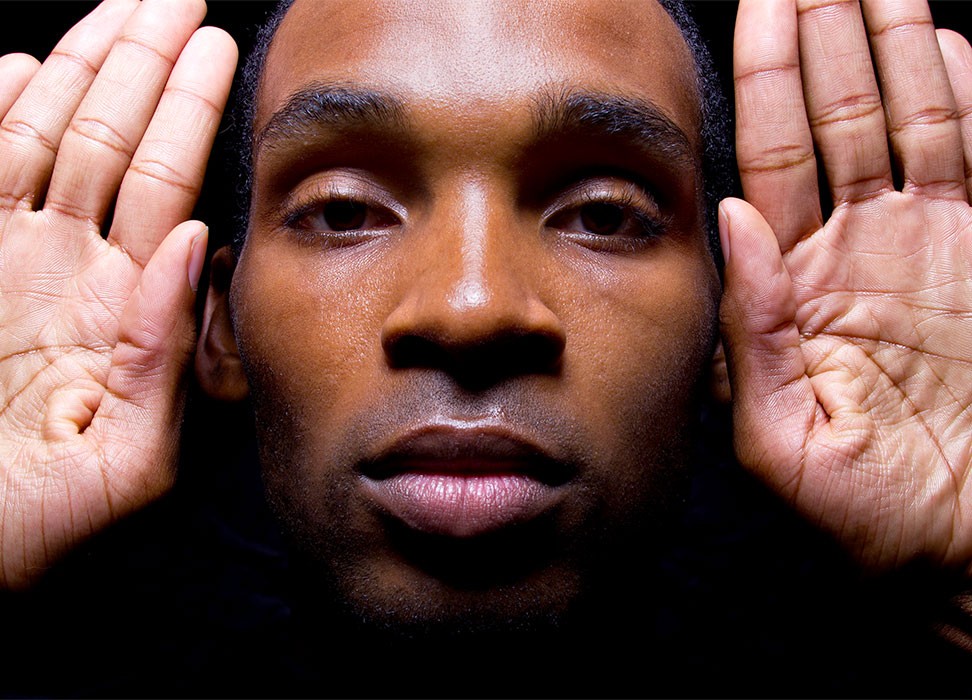

Специальный докладчик по вопросу о современных формах расизма, расовой дискриминации, ксенофобии и связанной с ними нетерпимости Ашвини К.П.

По словам специального докладчика, как и в случае с инструментами на основе географической привязки данных, данные о предыдущих арестах, на которые часто влияет системный расизм в системе уголовного правосудия, могут исказить прогнозы алгоритмов.

«Такие переменные, как социально-экономическое положение, уровень образования и местоположение, могут выступать в качестве косвенных индикаторов расы и поддерживать исторически сложившиеся предубеждения», – сказала Ашвини К.П.

В докладе представлен краткий анализ усилий по управлению и регулированию в сфере искусственного интеллекта на национальном, региональном и международном уровне.

«Технология искусственного интеллекта должна опираться на нормы международного права в области прав человека, – сказала Ашвини К.П. – Международная конвенция о ликвидации всех форм расовой дискриминации содержит наиболее полный запрет расовой дискриминации».

ИИ представляет риск для прав человека и в других сферах, в том числе в здравоохранении, где, как было доказано, отдельные инструменты для оценки рисков имеют поправочные коэффициенты, основанные на расе. Ашвини К.П. также указала на расовые предубеждения при применении ИИ в образовательных инструментах. Например, в связи особенностями работы и выборки данных в алгоритмах оценки успеваемости и успешности такие инструменты часто оценивают вероятность того, что представители расовых меньшинств добьются академических и профессиональных успехов, как более низкую, таким образом закрепляя их изоляцию и дискриминацию.

В своем программном заявлении «Права человека: путь к решениям» Верховный комиссар по правам человека Фолькер Тюрк отметил, что искусственный интеллект открывает недоступные прежде возможности для того, чтобы идти вперед в области реализации прав человека, при этом его негативное влияние на общество расширяется».

«В сферах с особенно высоким риском нарушения прав человека, в том числе в правоохранительной деятельности, единственный вариант – подождать, пока будут введены соответствующие гарантии», – сказал Тюрк.

По словам Ашвини К.П., несмотря на то что искусственный интеллект действительно имеет потенциал влияния, он не предлагает решения для всех проблем в обществе. Необходимо эффективное управление в этой сфере, чтобы обеспечить баланс рисков и преимуществ.

Ашвини К.П. считает, что регулирование ИИ позволит обеспечить этот баланс. Она рекомендует государствам более оперативно решать вопросы регулирования ИИ с учетом усиления расовой дискриминации; разработать нормативные рамки в сфере ИИ, опираясь на понимание системного расизма и права в области прав человека; закрепить юридические обязательства по проведению комплексной оценки надлежащего соблюдения прав человека, а также четкие критерии выявления расовых и этнических предрассудков в рамках развития и применения технологий ИИ; рассмотреть возможность запрета использования систем ИИ, продемонстрировавших неприемлемый уровень рисков в области прав человека, в том числе способствующих расовой дискриминации.

«Центральная роль прав человека в разработке, использовании и регулировании технологий имеет ключевое значение в нашем реагировании на эти риски», – сказал Тюрк.

* В октябре 2022 года Совет по правам человека назначил Ашвини К.П. Специальным докладчиком. Она является ученым, активистом и исследователем, занимается вопросами социальной изоляции, расы, дискриминации на основании происхождения и интерсекциональности. Она является приглашенным научным сотрудником Стэнфордского университета. В Индии она работала доцентом и была одним из основателей организации «Зария: женщины за достоинство и равенство», которая способствует солидарности и объединяет женщин из маргинализированных групп. К.П. Ашвини представляла индийских женщин из числа далитов в группах гражданского общества и оказывала им содействие в выработке стратегии по расширению возможностей женщин из маргинализированных сообществ и их участию в принятии решений в активизме и ведущих общественных движениях.